¿Qué significa ser desarrollador cuando el cliente ya llega con un plan armado por una IA? ¿Dónde termina el trabajo del modelo y dónde empieza tu verdadera responsabilidad como profesional?

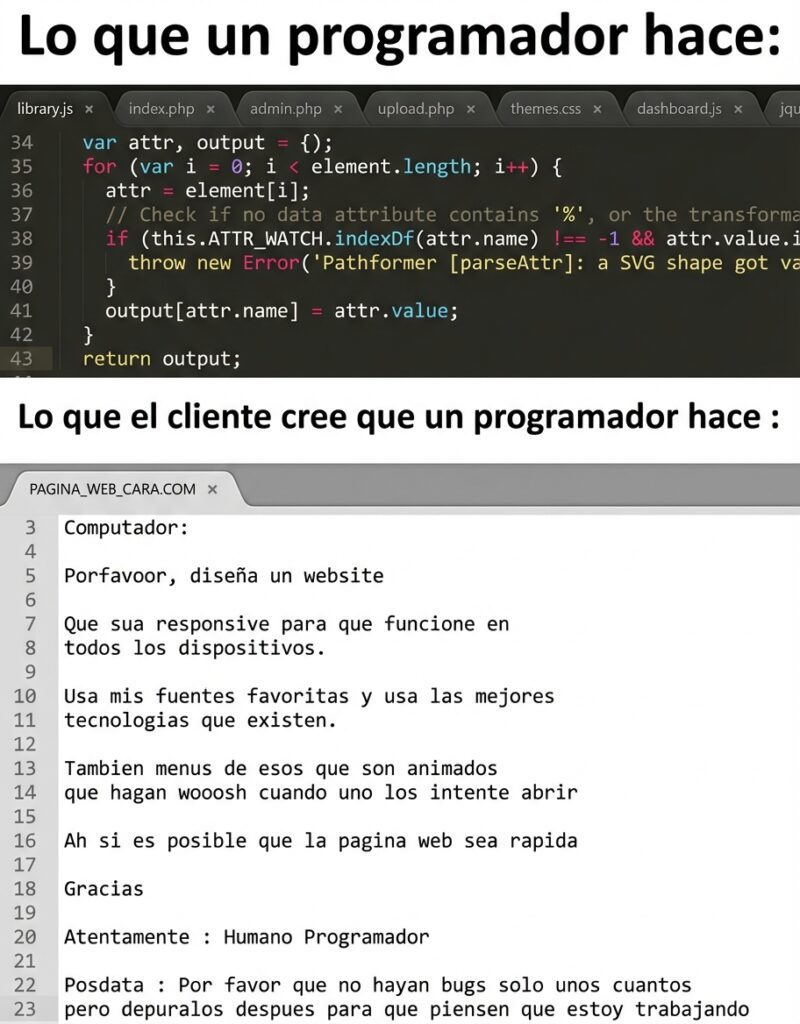

El viejo meme del «lo que el cliente pidió vs lo que se terminó haciendo» se queda corto. Antes exageraba la distancia entre la expectativa del usuario y lo que el dev lograba entregar. Hoy, con agentes de IA escribiendo especificaciones, prototipos e incluso fragmentos de código, el chiste ya no es que el cliente no sabe lo que quiere: es que llega con un documento «perfecto» generado por una IA… que alguien tiene que aterrizar al mundo real.

En este nuevo escenario, la responsabilidad del desarrollador se mueve del teclado al tablero: ya no es solo escribir líneas de código, sino diseñar entornos, orquestar agentes y proteger al usuario de la propia inteligencia artificial.

Tu nuevo cliente no es solo humano potenciado por agentes de IA

Durante años pensamos el desarrollo como un puente directo entre «cliente humano» y «software». El cliente hablaba, tú traducías a historias de usuario, lo convertías en tareas, escribías código y listo. Pero es bien sabido que la mejor interfaz para comunicarse con una máquina sigue siendo otro humano, con habilidades que solo este tiene y que le permiten ser creativo: sensibilidad al diseño, capacidad de análisis antropológico, investigación, criterio.

Hoy la cadena tiene un actor más: los agentes de IA. El usuario ya no solo te habla a ti; le habla primero a un modelo que:

- Le propone un plan de funcionalidades.

- Le arma pseudo-flujos, pantallas, incluso pseudo-código.

- Le hace creer que el salto entre idea y producto está a una respuesta de distancia.

Cuando ese cliente llega a ti, no está llegando «en blanco». Llega con algo que parece muy avanzado. Y ahí cambia tu papel: tu trabajo ya no es solo «entender al cliente»; ahora también tienes que entender qué hizo la IA, qué tiene sentido y qué es humo.

Eso te convierte en algo más que un programador: eres la persona que traduce entre tres mundos al mismo tiempo:

- Lo que el negocio realmente necesita.

- Lo que la IA propuso como solución.

- Lo que es técnicamente viable, seguro y mantenible en el tiempo.

De herramientas para humanos a entornos para humanos + agentes

Otra consecuencia de trabajar con agentes de IA es que tus «usuarios» ya no son solo personas. También son los propios agentes que van a ejecutar acciones en nombre del usuario.

No se trata únicamente de crear formularios bonitos o dashboards llenos de gráficas. Se trata de diseñar entornos donde un humano y un agente puedan colaborar sin destruir nada por el camino.

Piensa en integraciones seguras para salvaguardar tus entornos personales, tales como:

- Gmail o cualquier correo personal.

- Calendarios donde hay citas reales, clientes reales, vida personal.

- Sistemas de cobro, CRM, automatizaciones que afectan dinero o relaciones.

En ese contexto, el rol del desarrollador ya no es simplemente conectar APIs. Es definir:

- Qué puede hacer el agente y qué no.

- Qué datos ve, qué datos nunca debería ver.

- Cuándo necesita confirmación humana y cuándo puede actuar solo.

- Qué límites y salvaguardas se activan si algo se sale de lo normal.

Por ejemplo el agentmail.ai , con integracioes MCP y api, este es el area de juego donde donde la volatilidad de la gestio de la informcion no sea un problema.

Diseñar ese entorno es parte central de tu responsabilidad profesional. Porque si tú no pones límites, el modelo tampoco lo hará por instinto. Hará exactamente lo que le pidan, incluso cuando eso significa cruzar líneas que para un humano serían obvias.

Orquestar, validar y testear: el nuevo trabajo invisible

Cuando un cliente llega con un «plan perfecto» generado por una IA, es fácil caer en la trampa de creer que tu valor se reduce a ejecutar más rápido. Justo lo contrario: tu valor real empieza donde la IA se queda corta.

El desarrollador se convierte en un orquestador:

- Pide a los agentes que generen propuestas, código, pruebas.

- Compara versiones, valida supuestos, mide riesgos.

- Toma decisiones sobre qué se acepta, qué se ajusta y qué se descarta.

Y se convierte también en validador y tester de la propia IA:

- Revisando que las automatizaciones no hagan cosas absurdas en producción.

- Que los permisos no estén demasiado abiertos.

- Que los flujos tengan salidas claras cuando algo va mal.

Ningún modelo, por potente que sea, asume automáticamente la ética, el contexto de negocio o la responsabilidad legal. Esa capa sigue siendo humana, y muchas veces recae directamente sobre ti.

Del mínimo viable al «mínimo adorable»

Durante años se popularizó la idea del MVP: el «producto mínimo viable». Algo que apenas funciona, pero sirve para probar si vale la pena seguir invirtiendo.

Con herramientas de IA al alcance, ese estándar empieza a quedarse corto. Porque si un desarrollador potenciado por IA puede crear más y mejor en menos tiempo, entonces la expectativa deja de ser «hazme lo mínimo» y pasa a ser algo más cercano a un «mínimo adorable»:

- Que funcione, sí.

- Pero también que tenga cierto nivel de detalle.

- Que piense en automatizaciones reales, no solo en pantallas.

- Que aproveche capacidades de los agentes de IA en lugar de ignorarlas.

En otras palabras: el suelo sube. Lo que antes era «wow» hoy es lo básico. Y quien no use bien la IA para elevar ese estándar, se va a sentir cada vez más lento y más caro frente al mercado.

La brecha oculta: no todas las IAs son iguales (y el presupuesto importa)

Suena bonito decir que «la IA es accesible para todos». Sí, cualquiera puede abrir una cuenta gratuita y jugar con un modelo. Pero en la práctica, se está abriendo una nueva brecha:

- No es lo mismo trabajar solo con modelos gratuitos, con poco contexto y límites estrictos de uso.

- Que trabajar con agentes más potentes, mejor afinados, con más memoria y mejor integración en el stack del negocio.

Tu trabajo como desarrollador también queda condicionado por eso:

- El tipo de IA que puedes usar (por costo, por política, por stack).

- La capacidad económica del cliente para pagar modelos más avanzados, más tokens, más contexto.

Dos proyectos pueden sonar igual en el papel («hazme una app», «hazme una página»), pero el resultado final no será el mismo si detrás tienes:

- Agentes sofisticados con buen presupuesto y datos de calidad.

- O solo herramientas básicas gratuitas, sin acceso profundo a los sistemas del cliente.

Parte de tu responsabilidad es ser honesto con eso: explicar qué se puede lograr con el presupuesto y la IA disponible, y qué parte del «sueño» que le vendió otro modelo no es realista hoy.

No solo código: diseñar el entorno donde humano + IA trabajan juntos

La pregunta ya no es si la IA va a reemplazar a los desarrolladores, sino qué desarrolladores se van a volver irrelevantes.

Los que sigan viéndose solo como «escritores de código» van a competir contra modelos cada vez mejores en su propio terreno. Los que entiendan que su trabajo ahora es:

- Diseñar entornos seguros para humanos + agentes de IA.

- Orquestar, validar y testear lo que esos agentes producen.

- Traducir entre negocio, IA y tecnología de forma responsable.

van a ser los que tengan más trabajo, no menos.

La IA puede generar ideas, código y planes casi infinitos. Pero alguien tiene que decidir qué de todo eso vale la pena construir, cómo se construye sin romper nada y cómo se mantiene en el tiempo.

Esa sigue siendo tu responsabilidad.

Por, a mi parecer: la responsabilidad que no se puede delegar

Los agentes de IA ya están aquí. Generan especificaciones, recomiendan arquitecturas, escriben código y hasta proponen «roadmaps» enteros. El meme del cliente que no sabe lo que quiere se está convirtiendo en el cliente que llega con un documento impecable… que nadie ha contrastado con la realidad.

En ese contexto, el desarrollador que solo espera que le dicten tareas va a sobrar rápido. En cambio, el desarrollador que asume su nuevo rol como orquestador, diseñador de entornos y guardián de la seguridad y el sentido común se vuelve más valioso que nunca.

Porque por mucha autonomía que tengan los agentes de IA, todavía se necesita a alguien que haga la pregunta incómoda:

«¿Esto que la IA propone tiene sentido para este negocio, para este usuario y para este momento?»

Responderla bien sigue siendo trabajo humano (o algo se inventara por el camino). Y es, probablemente, la parte más importante de ser desarrollador en tiempos de agentes de IA.

Derrotero rápido (FAQ)

¿Qué rol tienen los desarrolladores con agentes de IA? Pasan de escribir código punto a punto a orquestar servicios, integrar LLMs y diseñar pipelines de automatización.

¿Se perderán empleos de desarrollador por IA? No necesariamente; cambiarán las habilidades requeridas hacia arquitectura de sistemas, datos y seguridad.

¿Qué habilidades debo aprender? Orquestación de modelos, ingeniería de prompts, observabilidad, y diseño de APIs seguras.

¿Cómo integrar agentes de IA en productos existentes? Empezar con casos de uso claros, prototipar con APIs de LLM y medir impacto antes de escalar.